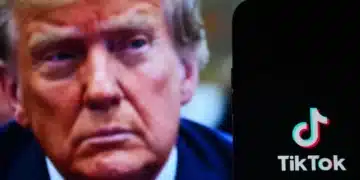

Tribunal dos EUA retoma processo contra TikTok por desafio de apagão de menina de 10 anos. Ações judiciais envolvendo plataforma de rede social.

Um tribunal de apelações dos Estados Unidos retomou um processo contra o TikTok movido pela mãe de uma menina de 10 anos que morreu após participar de um ‘desafio de apagão (blackout)‘, no qual os usuários da plataforma de rede social foram estimulados a se sufocar até desmaiar. Mesmo com a proteção normalmente oferecida pela lei federal às empresas de internet em relação ao conteúdo dos usuários, o Tribunal de Apelações do 3º Circuito dos EUA, com sede na Filadélfia, decidiu na terça-feira (27) que a mãe de Nylah Anderson pode buscar ações judiciais contra o algoritmo do TikTok que recomendou o desafio à sua filha.

A decisão do tribunal de apelações dos EUA representa um marco importante no debate sobre a responsabilidade das plataformas de rede social em proteger os usuários mais jovens de desafios perigosos. O caso da mãe de Nylah Anderson contra o TikTok destaca a necessidade de uma regulamentação mais rigorosa e de medidas de segurança aprimoradas para evitar tragédias semelhantes no futuro. A segurança dos usuários, especialmente dos mais vulneráveis, deve ser uma prioridade constante para as empresas que operam plataformas de rede social populares como o TikTok.

TikTok e a Responsabilidade Legal nas Plataformas de Rede Social

A juíza Patty Shwartz, em nome do painel de três juízes, ressaltou que a Seção 230 da Lei de Decência das Comunicações de 1996 concede imunidade apenas às informações provenientes de terceiros, não abrangendo as recomendações feitas pelo próprio TikTok por meio de um algoritmo subjacente à sua plataforma. Esta decisão marca uma mudança significativa em relação a interpretações anteriores da lei, que defendiam a imunidade das plataformas online por não filtrarem conteúdos prejudiciais transmitidos por usuários.

Shwartz argumentou que a recente decisão da Suprema Corte dos EUA, em julho, sobre a validade de leis estaduais que limitam o poder das redes sociais em restringir conteúdos questionáveis, reforça a ideia de que o algoritmo de uma plataforma reflete julgamentos editoriais sobre o discurso de terceiros. Portanto, a curadoria de conteúdo por meio de algoritmos não se enquadra na proteção da Seção 230.

O TikTok, ao fazer escolhas sobre o conteúdo recomendado e promovido para usuários específicos, está, de acordo com Shwartz, envolvido em seu próprio discurso primário. Esta abordagem desafia a visão anterior de que a plataforma poderia se isentar de responsabilidade com base na Seção 230. A empresa não emitiu comentários sobre o assunto até o momento.

A decisão recente reverteu a sentença de um juiz de primeira instância que havia rejeitado, com base na Seção 230, o processo movido por Tawainna Anderson contra o TikTok e sua empresa controladora ByteDance. O caso teve origem na trágica morte de Nylah, filha de Anderson, em 2021, após participar de um desafio do apagão utilizando uma alça de bolsa.

Jeffrey Goodman, advogado da mãe de Nylah, destacou que a decisão representa um revés significativo para as gigantes de tecnologia, que agora enfrentam uma maior responsabilidade legal em suas operações. O juiz do Circuito dos EUA, Paul Matey, emitiu um parecer parcialmente alinhado com a decisão, apontando que o TikTok, em sua busca por lucros, não pode alegar imunidade que não lhe foi concedida pelo Congresso. A discussão sobre o papel das plataformas de rede social e suas ações judiciais continua a evoluir, com potenciais implicações para o futuro do TikTok e outras empresas semelhantes.

Fonte: © TNH1