Nova ferramenta AI Overview, Google I/O 2024, gera respostas imprecisas de fontes duvidosas; entenda os equívocos do recurso experimental.

Descubra Mais 🔎 Assistente Virtual: o que é e como utilizar? Tudo o que você precisa conhecer🔔 Página do TechTudo no Facebook: siga as últimas novidades, dicas e análises Entre os casos mais inusitados produzidos pela nova IA, encontra-se a frase ‘Especialistas indicam consumir chocolate todos os dias para perder peso’ ao pesquisar sobre ‘Dieta para emagrecer’.

A inteligência artificial está cada vez mais presente em nosso cotidiano, auxiliando em diversas tarefas e proporcionando soluções inovadoras. É impressionante como a IA consegue gerar respostas rápidas e precisas, mesmo em situações inesperadas. A evolução da inteligência artificial promete revolucionar ainda mais a forma como interagimos com a tecnologia no futuro próximo.

Problemas com respostas equivocadas da IA

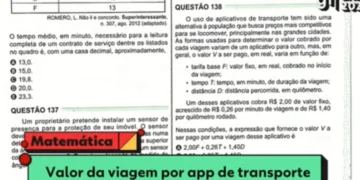

Neste caso específico, as informações apresentadas podem ser perigosas para os usuários. Vamos analisar o que motivou as respostas erradas do Google. O recurso de inteligência artificial do Google está entregando respostas imprecisas de fontes pouco confiáveis, o que tem gerado polêmica. A fase experimental do AI Overview está causando controvérsias entre os usuários nos EUA.

Ao ser questionado sobre como evitar que o queijo escorra da pizza, a IA sugeriu uma solução inusitada: adicionar 1/8 de xícara de cola branca ao molho. Essa recomendação foi baseada em um comentário antigo do Reddit, feito de forma sarcástica. Outro equívoco ocorreu ao responder sobre o mamífero com mais ossos no corpo, mencionando cobras, que são répteis.

Além disso, a IA afirmou que o Batman é um policial e um cachorro que jogou em ligas esportivas dos EUA, o que claramente não condiz com a realidade. O Google reconheceu esses erros e afirmou que está trabalhando para aprimorar a precisão da ferramenta, tomando medidas contra violações de políticas.

É importante ressaltar que algumas respostas podem ser prejudiciais, como a sugestão de que mulheres grávidas fumem cigarros diariamente. O Google enfatiza que o AI Overview ainda está em fase experimental e que está comprometido em melhorar sua confiabilidade.

Durante o lançamento do AI Overview no Google I/O 2024, a ferramenta já havia apresentado informações duvidosas. Mesmo em uma apresentação controlada, ao ser questionada sobre como consertar uma câmera analógica emperrada, a IA sugeriu uma solução que danificaria as fotos presentes no filme.

Alucinações em ferramentas de inteligência artificial

As respostas imprecisas não são exclusivas do AI Overview. Outras plataformas de inteligência artificial, como o ChatGPT da OpenAI e o Microsoft Copilot, também podem apresentar ‘alucinações’. Esses erros ocorrem quando a IA não possui dados suficientes para responder e acaba inventando informações para evitar ficar sem resposta.

É importante observar que essas falhas podem resultar em respostas imprecisas, tendenciosas ou até mesmo preconceituosas. Em casos como esse, a IA pode buscar soluções em fontes não confiáveis, levando a recomendações inadequadas para os usuários.

Fonte: @Tech Tudo